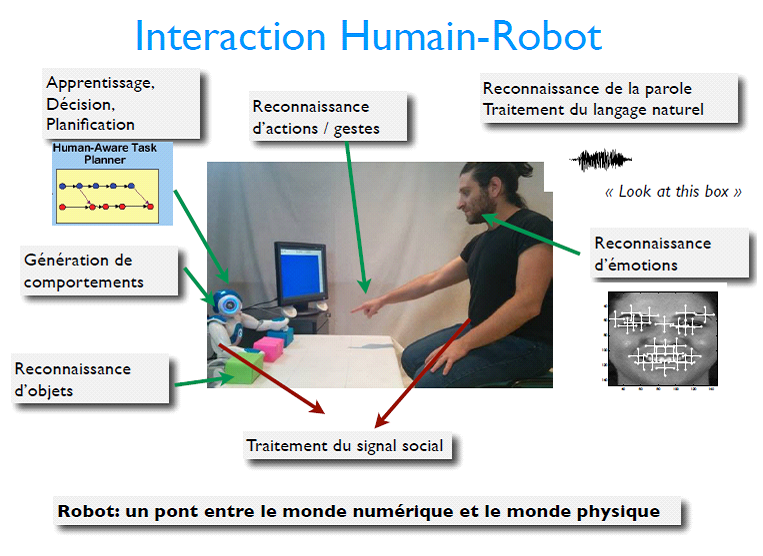

Ce système permet aux utilisateurs de donner des commandes telles que « avance de quelques pas et tourne à droite ».

MotionGlot traduit ces instructions en mouvements adaptés à divers types de robots et d’avatars animés, qu’ils soient humanoïdes ou quadrupèdes.

En assimilant le mouvement à un langage, MotionGlot établit des correspondances entre des directives linguistiques et des actions physiques.

Cette approche ouvre la porte à une multitude d’applications, notamment dans les domaines de la collaboration, du jeu vidéo et de la réalité virtuelle.

Pour former ce modèle, les chercheurs se sont appuyés sur deux ensembles de données riches en mouvements annotés, ce qui lui permet de produire des résultats fiables, même pour des actions inédites.

Par exemple, il peut exécuter des demandes spécifiques telles que « un robot marche en arrière » ou des instructions plus abstraites, comme « un robot marche joyeusement ».

En rendant cette technologie accessible au grand public, les chercheurs visent à stimuler de nouvelles innovations dans les secteurs de la robotique et de l’animation numérique.

Source: IA Tech news